Der Chip in einer Kamera, genauer gesagt der Bildsensor, ist das Herzstück eines jeden modernen Bildgebungssystems. Er ist verantwortlich dafür, das Licht, das durch das Objektiv fällt, in ein elektronisches Signal umzuwandeln, aus dem letztendlich ein Bild entsteht. Diese Sensoren sind hochkomplexe Halbleiterbauelemente, die Millionen winziger lichtempfindlicher Elemente, sogenannter Pixel, enthalten. Obwohl viele Kamerahersteller existieren, wird die Mehrheit der Sensoren nur von einer Handvoll spezialisierter Unternehmen produziert. Dennoch können Kameras mit demselben Sensor sehr unterschiedliche Leistungen und Eigenschaften aufweisen, was an der Gestaltung der begleitenden Elektronik und der Signalverarbeitung liegt. Früher kamen in Kameras Bildaufnahmeröhren wie Vidicons zum Einsatz, deren Nomenklatur für Sensorgrößen bis heute nachwirkt. Heute dominieren jedoch zwei Haupttechnologien den Markt, insbesondere im Bereich der industriellen Bildverarbeitung: CCD- und CMOS-Sensoren.

Bauweise und Funktion der Sensortechnologien

Die Entwicklung der modernen Bildsensoren war ein entscheidender Schritt in der Geschichte der Fotografie und Bildverarbeitung. Zwei Technologien haben sich dabei als besonders prägend erwiesen: das Charge-Coupled Device (CCD) und der Complementary Metal Oxide Semiconductor (CMOS). Beide haben das Potenzial, Licht in elektrische Signale umzuwandeln, tun dies aber auf grundlegend unterschiedliche Weise, was zu spezifischen Vor- und Nachteilen führt.

Charge-Coupled Device (CCD)

Das Charge-Coupled Device (CCD) wurde 1969 von Wissenschaftlern der Bell Labs erfunden und war lange Zeit die vorherrschende Technologie zur Bilderfassung, von der digitalen Astrofotografie bis zur industriellen Inspektion. Ein CCD-Sensor ist ein Siliziumchip, der eine Anordnung von lichtempfindlichen Stellen, den Pixeln, enthält. Der Begriff „Ladungsgekoppeltes Bauelement“ bezieht sich auf die Methode, wie Ladungspakete auf dem Chip von den Fotostellen zum Auslesen bewegt werden. Dies geschieht über ein Schieberegister, ähnlich einer Eimerkette (Bucket Brigade). Taktimpulse erzeugen Potenzialmulden, um die Ladungspakete über den Chip zu verschieben, bevor sie am Ende in eine Spannung umgewandelt werden. Der CCD-Sensor selbst ist ein analoges Bauelement. In Digitalkameras wird das Ausgangssignal sofort durch einen Analog-Digital-Wandler (ADC), der sich entweder auf oder außerhalb des Chips befindet, in ein digitales Signal umgewandelt. Bei Analogkameras wird die Spannung jeder Stelle in einer bestimmten Reihenfolge ausgelesen, wobei Synchronisationspulse hinzugefügt werden, um das Bild zu rekonstruieren.

Die Geschwindigkeit, mit der die Ladungspakete übertragen werden können, begrenzt die Auslesegeschwindigkeit und stellt den Hauptnachteil von CCD-Sensoren in Bezug auf die Geschwindigkeit dar. Gleichzeitig führt dieser Ladungstransfer jedoch zur hohen Empfindlichkeit und zur bemerkenswerten Gleichmäßigkeit von Pixel zu Pixel. Da jedes Ladungspaket dieselbe Spannungs-Umwandlung durchläuft, ist die Reaktion des CCD-Sensors über seine gesamte Fläche sehr einheitlich. Der Ladungstransfer führt aber auch zum sogenannten Blooming-Effekt. Dieser tritt auf, wenn die Ladung von einer stark belichteten Fotostelle aufgrund einer begrenzten Ladungskapazität (Wellentiefe) auf benachbarte Stellen überschwappt. Dies setzt eine Obergrenze für den nutzbaren Dynamikbereich des Sensors und äußert sich als Verschmieren heller Stellen im Bild. Um die begrenzte Wellentiefe auszugleichen, werden bei CCD-Sensoren häufig Mikrolinsen verwendet. Diese erhöhen den Füllfaktor, d.h. die effektive lichtempfindliche Fläche der Pixel, um den Platz auszugleichen, der auf dem Chip durch die Schieberegister eingenommen wird. Dies verbessert die Effizienz der Pixel, erhöht aber auch die Winkelabhängigkeit für einfallende Lichtstrahlen, die für eine effiziente Sammlung nahezu senkrecht auf den Sensor treffen müssen.

Complementary Metal Oxide Semiconductor (CMOS)

Der Complementary Metal Oxide Semiconductor (CMOS) wurde bereits 1963 erfunden, fand aber erst in den 1990er Jahren breite Anwendung in der Bildgebung. Bei einem CMOS-Sensor wird die Ladung jedes lichtempfindlichen Pixels direkt an der Pixelstelle in eine Spannung umgewandelt. Das Signal wird dann zeilen- und spaltenweise zu mehreren, oft auf dem Chip integrierten, Analog-Digital-Wandlern gemultiplext. CMOS ist konstruktionsbedingt eher ein digitales Bauelement. Jede Pixelstelle besteht im Wesentlichen aus einer Fotodiode und mehreren Transistoren (typischerweise drei), die Funktionen wie das Zurücksetzen (Reset), die Verstärkung und Ladungsumwandlung sowie die Auswahl oder das Multiplexing übernehmen. Diese Architektur ermöglicht die hohe Geschwindigkeit von CMOS-Sensoren, führt aber auch zu einer geringeren Empfindlichkeit und einem höheren Festmusterrauschen (Fixed-Pattern Noise) aufgrund von Fertigungsunterschieden in den vielen Umwandlungsschaltungen pro Pixel. Die Multiplexing-Konfiguration eines CMOS-Sensors ist oft mit einem elektronischen Rolling Shutter gekoppelt, bei dem die Pixel zeilenweise ausgelesen werden. Mit zusätzlichen Transistoren pro Pixel kann jedoch auch ein Global Shutter realisiert werden, bei dem alle Pixel gleichzeitig belichtet und dann sequenziell ausgelesen werden.

Ein weiterer Vorteil von CMOS-Sensoren ist ihr geringerer Stromverbrauch und ihre geringere Wärmeableitung im Vergleich zu äquivalenten CCD-Sensoren, da weniger Ladung (Strom) fließt. Die Fähigkeit von CMOS-Sensoren, hohe Lichtintensitäten ohne Blooming zu verarbeiten, ermöglicht ihren Einsatz in speziellen Kameras mit hohem Dynamikbereich, die sogar Schweißnähte oder Glühfäden abbilden können. CMOS-Kameras sind tendenziell auch kleiner als ihre digitalen CCD-Gegenstücke, da digitale CCD-Kameras zusätzliche ADC-Schaltkreise außerhalb des Chips benötigen.

Der mehrschichtige MOS-Fertigungsprozess eines CMOS-Sensors erlaubt nicht den Einsatz von Mikrolinsen auf dem Chip, was die effektive Lichtsammel-Effizienz oder den Füllfaktor des Sensors im Vergleich zu einem äquivalenten CCD-Sensor verringert. Diese geringere Effizienz in Kombination mit der Pixel-zu-Pixel-Inkonsistenz trägt zu einem niedrigeren Signal-Rausch-Verhältnis (SNR) und einer insgesamt geringeren Bildqualität im Vergleich zu CCD-Sensoren bei, obwohl hier in den letzten Jahren enorme Fortschritte erzielt wurden. Die Qualität von CMOS-Sensoren verbessert sich rasant, und in vielen Anwendungen haben sie CCDs bereits überholt oder ersetzen sie zunehmend. Fortschritte in der Fertigung ermöglichen heute CMOS-Sensoren mit sehr hoher Auflösung (bis zu 8K oder 4K UltraHD) zu vergleichsweise geringen Kosten, was sie für Konsumentenkameras und IP-Überwachungssysteme attraktiv macht.

Vergleichstabelle: CCD vs. CMOS

Die Unterschiede zwischen CCD- und CMOS-Sensoren sind vielfältig und beeinflussen die Leistung einer Kamera maßgeblich. Die folgende Tabelle gibt einen Überblick über die wichtigsten Vergleichspunkte:

| Eigenschaft | CCD | CMOS |

|---|---|---|

| Pixel-Signal | Ladungspaket | Spannung |

| Chip-Signal | Analog (intern), Digital (Ausgang) | Digital |

| Füllfaktor | Hoch (oft mit Mikrolinsen) | Mäßig (verbessert sich) |

| Empfindlichkeit | Hoch | Mäßig - Hoch (verbessert sich) |

| Rauschpegel | Niedrig | Mäßig - Hoch (verbessert sich) |

| Dynamikbereich | Mäßig | Hoch (spezielle HDR-CMOS) |

| Gleichmäßigkeit | Hoch | Niedrig (verbessert sich) |

| Auflösung | Niedrig - Hoch | Niedrig - Hoch |

| Geschwindigkeit | Mäßig - Hoch | Hoch |

| Stromverbrauch | Mäßig - Hoch | Niedrig |

| Komplexität (Pixel) | Einfach | Mäßig |

| Herstellungskosten | Mäßig | Mäßig (oft günstiger) |

Alternative Sensormaterialien

Neben den weit verbreiteten Silizium-basierten CCD- und CMOS-Sensoren gibt es spezielle Technologien für andere Wellenlängenbereiche. Die Nahinfrarot-Bildgebung (SWIR - Short-Wave Infrared) im Bereich von etwa 0,9 bis 1,7 µm (manchmal auch 0,7 bis 2,5 µm) gewinnt an Bedeutung. SWIR ermöglicht die Abbildung von Dichteunterschieden oder die Sicht durch Nebel. Normale Siliziumsensoren sind in diesem Bereich nicht empfindlich genug. Hier kommen spezielle Indiumgalliumarsenid (InGaAs)-Sensoren zum Einsatz. InGaAs hat eine Bandlücke, die es für die Erzeugung eines Fotostroms aus Infrarotenergie nutzbar macht. Diese Sensoren basieren oft auf der CMOS-Architektur mit einer Anordnung von InGaAs-Fotodioden.

Bei noch längeren Wellenlängen, im Bereich der thermischen Bildgebung (typischerweise 7-14 µm), dominieren Mikrobolometer-Arrays. Bei diesen Sensoren besitzt jedes Pixel ein Bolometer, dessen elektrischer Widerstand sich mit der Temperatur ändert. Diese Widerstandsänderung wird durch Elektronik im Substrat in eine Spannung umgewandelt und ausgelesen. Mikrobolometer haben den Vorteil, dass sie im Gegensatz zu vielen anderen Infrarot-Bildgebern keine aktive Kühlung benötigen, was sie für viele Anwendungen sehr praktisch macht.

Wichtige Merkmale von Kamerasensoren

Über die grundlegende Technologie hinaus gibt es weitere Merkmale, die die Leistung und die Anwendungsmöglichkeiten eines Kamerasensors bestimmen.

Pixel

Wenn Licht von einem Bild auf einen Kamerasensor fällt, wird es von einer Matrix kleiner lichtempfindlicher Bereiche, den Pixeln, gesammelt. Das Bild wird in diese kleinen diskreten Pixel unterteilt. Die Informationen von diesen Fotostellen werden gesammelt, organisiert und zur Anzeige auf einem Monitor übertragen. Pixel können beispielsweise Fotodioden sein, die eine Ladung proportional zur Lichtmenge erzeugen, die auf diesen bestimmten Punkt des Sensors fällt, räumlich begrenzt und gespeichert. Die Fähigkeit eines Pixels, ein einfallendes Photon in Ladung umzuwandeln, wird durch seine Quanteneffizienz spezifiziert. Wenn beispielsweise von zehn einfallenden Photonen vier Fotoelektronen erzeugt werden, beträgt die Quanteneffizienz 40%. Typische Werte für die Quanteneffizienz bei Halbleiter-Bildsensoren liegen zwischen 30 und 60%. Die Quanteneffizienz hängt von der Wellenlänge ab und ist nicht unbedingt gleichmäßig über den gesamten Bereich der Lichtintensität. Spektrale Empfindlichkeitskurven geben oft die Quanteneffizienz als Funktion der Wellenlänge an.

Bei Digitalkameras sind Pixel typischerweise quadratisch geformt. Gängige Pixelgrößen liegen zwischen 3 und 10 µm. Obwohl Sensoren oft einfach nach der Anzahl der Pixel spezifiziert werden, ist die Größe für die Bildoptik sehr wichtig. Große Pixel haben im Allgemeinen hohe Ladungssättigungskapazitäten und hohe Signal-Rausch-Verhältnisse (SNR). Mit kleinen Pixeln ist es relativ einfach, eine hohe Auflösung bei fester Sensorgröße und Vergrößerung zu erreichen, obwohl Probleme wie der Blooming-Effekt schwerwiegender werden und das Pixel-Crosstalk den Kontrast bei hohen räumlichen Frequenzen verringert. Ein einfaches Maß für die Sensorauflösung ist die Anzahl der Pixel pro Millimeter.

Analoge CCD-Kameras haben oft rechteckige Pixel (größer in der vertikalen Dimension). Dies ist ein Ergebnis der begrenzten Anzahl von Scanlinien in den Signalstandards (525 Linien für NTSC, 625 Linien für PAL) aufgrund von Bandbreitenbeschränkungen. Asymmetrische Pixel ergeben eine höhere horizontale Auflösung als vertikale. Analoge CCD-Kameras (mit demselben Signalstandard) haben normalerweise die gleiche vertikale Auflösung. Aus diesem Grund ist es in der Bildgebungsindustrie Standard, die Auflösung in Bezug auf die horizontale Auflösung anzugeben.

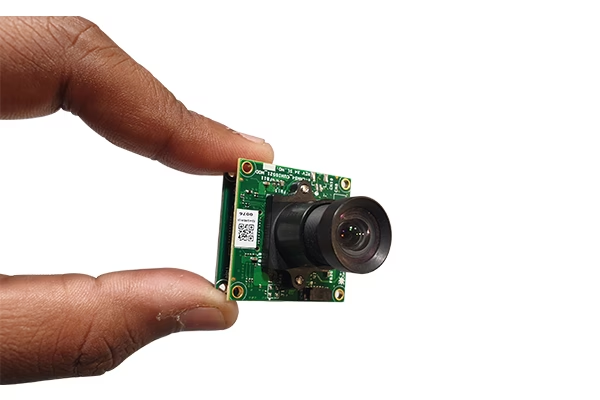

Sensorgröße

Die Größe der aktiven Fläche eines Kamerasensors ist wichtig für die Bestimmung des Sichtfeldes (Field of View, FOV) des Systems. Bei fester primärer Vergrößerung (bestimmt durch das Objektiv) ergeben größere Sensoren größere Sichtfelder. Es gibt verschiedene Standardgrößen für Flächensensoren: 1/4", 1/3", 1/2", 1/1.8", 2/3", 1" und 1.2", wobei auch größere verfügbar sind. Die Nomenklatur dieser Standards stammt noch von den Vidicon-Vakuumröhren, die für Fernsehübertragungen verwendet wurden, daher ist es wichtig zu beachten, dass die tatsächlichen Abmessungen der Sensoren abweichen. Es gibt keine direkte Verbindung zwischen der Sensorgröße (z.B. 1/2") und ihren physikalischen Abmessungen in Zoll; es ist rein eine historische Konvention. Die meisten dieser Standards behalten jedoch ein Seitenverhältnis von 4:3 (Horizontal: Vertikal) bei.

Ein Problem, das bei Bildgebungsanwendungen häufig auftritt, ist die Fähigkeit eines Objektivs, bestimmte Sensorgrößen zu unterstützen. Wenn der Sensor zu groß für das Objektivdesign ist, kann das resultierende Bild zu den Rändern hin verblassen und degradieren, was als Vignettierung bezeichnet wird (Auslöschung von Strahlen, die durch die äußeren Ränder des Objektivs verlaufen). Dies wird oft als Tunneleffekt bezeichnet, da die Ränder des Sichtfeldes dunkel werden. Kleinere Sensorgrößen zeigen dieses Vignettierungsproblem nicht.

Bildrate und Belichtungszeit

Die Bildrate (Frame Rate) bezieht sich auf die Anzahl der vollständigen Bilder (Frames), die pro Sekunde aufgenommen werden. Bei Hochgeschwindigkeitsanwendungen ist es vorteilhaft, eine höhere Bildrate zu wählen, um mehr Bilder des Objekts zu erfassen, während es sich durch das Sichtfeld bewegt. Die Belichtungszeit (Shutter Speed) entspricht der Zeit, während der der Sensor Licht sammelt. Die Belichtungszeit steuert die Menge des einfallenden Lichts. Kamerablooming (verursacht durch Überbelichtung) kann durch Verringerung der Beleuchtung oder durch Erhöhung der Belichtungszeit gesteuert werden. Eine Erhöhung der Belichtungszeit kann auch helfen, scharfe Momentaufnahmen eines sich bewegenden Objekts zu erstellen, das bei Live-Video möglicherweise nur 30 Mal pro Sekunde abgetastet wird.

Im Gegensatz zu analogen Kameras, bei denen die Bildrate meist durch die Anzeige vorgegeben ist, ermöglichen Digitalkameras einstellbare Bildraten. Die maximale Bildrate eines Systems hängt von der Auslesegeschwindigkeit des Sensors, der Datenübertragungsrate der Schnittstelle (einschließlich Kabel) und der Anzahl der Pixel (Datenmenge pro Bild) ab. In einigen Fällen kann eine Kamera mit einer höheren Bildrate betrieben werden, indem die Auflösung durch Pixel-Binning (Zusammenfassen von Pixeln) oder die Einschränkung des interessierenden Bereichs (Area of Interest, ROI) reduziert wird. Dies verringert die Datenmenge pro Bild und ermöglicht so die Übertragung von mehr Bildern bei fester Übertragungsrate. Die Belichtungszeit ist in guter Näherung der Kehrwert der Bildrate. Es gibt jedoch eine endliche Mindestzeit zwischen den Belichtungen (in der Größenordnung von Hunderten von Mikrosekunden), die durch das Zurücksetzen der Pixel und das Auslesen bedingt ist, obwohl viele Kameras die Möglichkeit haben, ein Bild auszulesen, während das nächste belichtet wird (Pipelining). Diese Mindestzeit ist oft im Datenblatt der Kamera zu finden.

CMOS-Kameras haben das Potenzial für höhere Bildraten, da das Auslesen jedes Pixels schneller erfolgen kann als der Ladungstransfer im Schieberegister eines CCD-Sensors. Bei Digitalkameras können Belichtungen von wenigen Sekunden bis zu Minuten durchgeführt werden, wobei die längsten Belichtungen nur mit CCD-Kameras möglich sind, die geringere Dunkelströme und ein geringeres Rauschen im Vergleich zu CMOS aufweisen. Das CMOS-eigene Rauschen begrenzt ihre nutzbare Belichtungszeit auf nur Sekunden.

Elektronischer Verschluss

Bis vor wenigen Jahren verwendeten CCD-Kameras fast ausschließlich elektronische oder Global Shutter, während alle CMOS-Kameras auf Rolling Shutter beschränkt waren. Ein Global Shutter ist analog zu einem mechanischen Verschluss: Alle Pixel werden gleichzeitig belichtet und abgetastet, wobei das Auslesen dann sequenziell erfolgt; die Photonenerfassung beginnt und endet gleichzeitig für alle Pixel. Ein Rolling Shutter hingegen belichtet, tastet ab und liest sequenziell aus; das bedeutet, jede Zeile des Bildes wird zu einem etwas anderen Zeitpunkt abgetastet. Bei Bildern von sich bewegenden Objekten führt ein Rolling Shutter intuitiv zu Verzerrungen (Verbiegungen). Dieser Effekt kann bei langsamen Geschwindigkeiten minimal sein, bei schnellen Bewegungen jedoch sehr ausgeprägt. Die Implementierung eines Global Shutter bei CMOS erfordert eine komplexere Architektur als das Standard-Rolling-Shutter-Modell, mit zusätzlichen Transistoren und Speicherkondensatoren pro Pixel, was auch Pipelining ermöglicht. Da die Verfügbarkeit von CMOS-Sensoren mit Global Shutter stetig zunimmt, sind sowohl CCD- als auch CMOS-Kameras für Hochgeschwindigkeitsanwendungen mit Bewegung nützlich. Im Gegensatz zu Global und Rolling Shutter bezieht sich ein Asynchronous Shutter auf die ausgelöste Belichtung der Pixel. Das bedeutet, die Kamera ist bereit, ein Bild aufzunehmen, aktiviert aber die Pixel erst nach dem Empfang eines externen Trigger-Signals. Dies steht im Gegensatz zu einer normalen konstanten Bildrate, die als internes Auslösen des Verschlusses betrachtet werden kann.

Sensortaps

Eine Möglichkeit, die Auslesegeschwindigkeit eines Kamerasensors zu erhöhen, ist die Verwendung mehrerer Ausgänge, sogenannter Sensortaps. Das bedeutet, dass nicht alle Pixel sequenziell über einen einzigen Ausgangsverstärker und ADC ausgelesen werden, sondern das Bildfeld aufgeteilt und über mehrere Ausgänge gleichzeitig ausgelesen wird. Häufig sieht man eine Dual-Tap-Konfiguration, bei der die linke und rechte Hälfte des Bildfeldes separat ausgelesen werden. Dies verdoppelt effektiv die Bildrate und ermöglicht eine einfache Rekonstruktion des Bildes durch Software. Es ist wichtig zu beachten, dass, wenn die Verstärkung zwischen den Sensortaps nicht identisch ist oder die ADCs leicht unterschiedliche Leistungen aufweisen, was in der Regel der Fall ist, eine sichtbare Trennlinie oder ein Helligkeitsunterschied im rekonstruierten Bild auftreten kann. Dies kann jedoch kalibriert werden. Viele große Sensoren mit mehr als ein paar Millionen Pixeln verwenden mehrere Sensortaps. Dies gilt hauptsächlich für Digital progressive-Scan-Kameras; andernfalls können Schwierigkeiten bei der Anzeige auftreten. Die Leistung eines Sensors mit mehreren Taps hängt stark von der Implementierung der internen Kamerahardware ab.

Spektrale Eigenschaften

Die Empfindlichkeit eines Kamerasensors gegenüber verschiedenen Lichtwellenlängen ist ein weiteres wichtiges Merkmal, das seine Anwendungsmöglichkeiten bestimmt.

Monochrome Sensoren

CCD- und CMOS-Sensoren sind im Allgemeinen für Wellenlängen von etwa 350 bis 1050 nm empfindlich, wobei der Bereich üblicherweise von 400 bis 1000 nm angegeben wird. Diese Empfindlichkeit wird durch die spektrale Empfindlichkeitskurve des Sensors dargestellt. Die meisten hochwertigen Kameras verfügen über einen Infrarot-(IR)-Sperrfilter, um speziell im sichtbaren Spektrum Bildgebung zu ermöglichen. Diese Filter sind manchmal abnehmbar, um auch im nahen IR-Bereich Bilder aufnehmen zu können.

CMOS-Sensoren sind im Allgemeinen empfindlicher für IR-Wellenlängen als CCD-Sensoren. Dies resultiert aus der größeren Tiefe ihrer aktiven Fläche. Die Eindringtiefe eines Photons hängt von seiner Frequenz ab, sodass größere Tiefen bei gegebener aktiver Flächendicke weniger Fotoelektronen erzeugen und die Quanteneffizienz verringern können. Allerdings ermöglicht die Konstruktion von CMOS-Pixeln eine effektivere Ladungssammlung in tieferen Schichten.

Farbsensoren

Der Halbleitersensor selbst kann keine Farben unterscheiden; er registriert lediglich die Intensität des einfallenden Lichts. Es gibt zwei Haupttypen von Farb-CCD-Kameras: Single-Chip- und Drei-Chip-Kameras. Single-Chip-Farbkameras sind eine gängige, kostengünstige Lösung und verwenden ein Mosaikfilter (z.B. Bayer-Filter) über den Pixeln, um das einfallende Licht in verschiedene Farben zu zerlegen. Jede Farbe wird dann von einem bestimmten Satz von Pixeln erfasst. Da mehr Pixel benötigt werden, um Farbe zu „erkennen“ und das vollständige Farbbild durch Interpolation (Demosaicing) berechnet werden muss, haben Single-Chip-Farbkameras naturgemäß eine geringere tatsächliche Auflösung als ihre monochromen Gegenstücke mit der gleichen Pixelanzahl. Das Ausmaß dieses Auflösungsverlustes hängt stark vom herstellerspezifischen Farbinterpolationsalgorithmus ab.

Drei-Chip-Farb-CCD-Kameras wurden entwickelt, um dieses Auflösungsproblem zu lösen. Sie verwenden ein Prisma, um jeden Abschnitt des einfallenden Spektrums (Rot, Grün, Blau) auf einen separaten Sensorchip zu lenken. Dies ermöglicht eine genauere Farbwiedergabe, da jeder Punkt im Raum des Objekts separate RGB-Intensitätswerte hat, anstatt dass ein Algorithmus die Farbe bestimmen muss. Drei-Chip-Kameras bieten extrem hohe Auflösungen und eine hervorragende Farbtreue, haben aber eine geringere Lichtempfindlichkeit und sind deutlich teurer. Generell sind spezielle 3CCD-Objektive erforderlich, die gut für Farben korrigiert sind und den geänderten optischen Pfad sowie eventuell reduzierte Abstände am hinteren Ende des Objektivs (bei C-Mount) kompensieren. Die Wahl zwischen Single-Chip und Drei-Chip hängt letztlich von den Anforderungen der Anwendung ab.

Anwendungen von Kamerasensoren

Die Vielfalt der Sensortechnologien und ihrer Merkmale ermöglicht eine breite Palette von Anwendungen, von alltäglichen Geräten bis hin zu spezialisierten wissenschaftlichen Instrumenten.

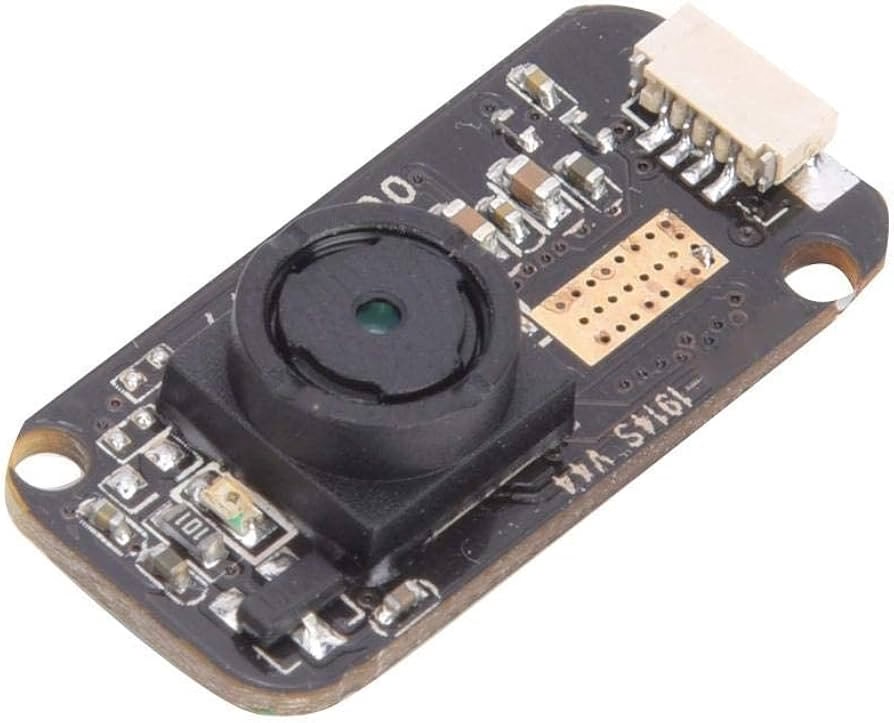

Smartphones sind heute die größte Anwendungsplattform für Kamerasensoren. Hier dominieren CMOS-Sensoren aufgrund ihrer Kosteneffizienz, geringen Größe und niedrigem Stromverbrauch. Die kontinuierlichen Fortschritte in der CMOS-Fertigung haben die Bildqualität so weit verbessert, dass sie für die meisten Verbraucheranwendungen mehr als ausreichend ist. Die Miniaturisierung ist hier ein Schlüsselfaktor, der es ermöglicht, leistungsstarke Kameras in immer dünnere Geräte zu integrieren.

In der industriellen Bildverarbeitung (Machine Vision) werden sowohl CCD- als auch CMOS-Sensoren eingesetzt, je nach den spezifischen Anforderungen. CCDs werden oft dort bevorzugt, wo höchste Bildqualität, geringes Rauschen und hohe Gleichmäßigkeit bei schwierigen Lichtverhältnissen entscheidend sind, z.B. bei Präzisionsmessungen oder Inspektionen. CMOS-Sensoren punkten mit hoher Geschwindigkeit und Flexibilität, insbesondere bei Anwendungen, die hohe Bildraten oder Global Shutter zur Aufnahme schneller Bewegungen erfordern, wie z.B. bei der Qualitätskontrolle auf Förderbändern.

Auch im Bereich der Sicherheitstechnik sind CMOS-Sensoren aufgrund ihrer niedrigen Kosten und der einfachen Integration in Überwachungskameras weit verbreitet. Moderne IP-Kameras mit hoher Auflösung (4K, 8K) basieren häufig auf CMOS-Technologie. Für spezielle Anwendungen, die eine sehr hohe Lichtempfindlichkeit oder die Erfassung von schnell bewegten Objekten unter schwierigen Bedingungen erfordern (z.B. Kennzeichenerfassung bei Nacht), werden jedoch teilweise immer noch CCD-Sensoren eingesetzt, obwohl auch hier CMOS-Sensoren mit verbesserten Global-Shutter-Fähigkeiten aufholen.

In der Astronomie, wo es oft darum geht, schwaches Licht über lange Zeiträume zu sammeln, waren CCD-Sensoren lange Zeit die erste Wahl. Ihre hohe Quanteneffizienz, geringes Rauschen und geringer Dunkelstrom machen sie ideal für Langzeitbelichtungen. Weltraumteleskope wie das Hubble-Teleskop verwenden CCD-Arrays. Auch in wissenschaftlichen Instrumenten wie Spektrometern und analytischen Geräten findet man häufig CCD-Sensoren.

CMOS-Chips werden auch in einer Vielzahl anderer elektronischer Geräte eingesetzt, nicht nur für die Bildgebung. Ihre Effizienz und die Kompatibilität mit Standard-Halbleiterfertigungsprozessen machen sie zu einer kostengünstigen Wahl für Logikschaltungen, Speicher und Mixed-Signal-ICs (Schaltungen, die sowohl analoge als auch digitale Signale verarbeiten). Sie sind ein grundlegender Baustein der modernen Elektronik.

Häufig gestellte Fragen zu Kamerasensoren

Hier beantworten wir einige häufige Fragen rund um das Thema Kamerachips:

Was genau ist der Chip in einer Digitalkamera?

Der Chip ist der Bildsensor, ein elektronisches Bauteil, das das Licht, das durch das Objektiv fällt, in elektrische Signale umwandelt. Diese Signale werden dann verarbeitet, um das digitale Bild zu erzeugen.

Was sind die Hauptunterschiede zwischen CCD und CMOS?

Der Hauptunterschied liegt in der Art und Weise, wie das Signal ausgelesen wird. CCDs verwenden ein Ladungsübertragungsregister, während CMOS die Ladung direkt am Pixel in eine Spannung umwandelt und diese dann ausliest. Dies führt zu Unterschieden in Geschwindigkeit, Rauschen, Stromverbrauch und Fertigungskosten.

Welche Sensortechnologie ist besser, CCD oder CMOS?

Es gibt keine pauschale Antwort. CCDs waren lange Zeit führend bei Bildqualität, Rauschen und Gleichmäßigkeit. CMOS ist schneller, energieeffizienter und günstiger in der Herstellung. Durch Fortschritte hat CMOS in vielen Bereichen die Leistung von CCDs erreicht oder übertroffen. Die Wahl hängt von der spezifischen Anwendung und den Prioritäten ab (z.B. Geschwindigkeit vs. Rauschen, Kosten vs. Bildqualität).

Was bedeutet der Blooming-Effekt und welche Sensoren sind davon betroffen?

Der Blooming-Effekt tritt auf, wenn Pixel überbelichtet werden und die überschüssige Ladung auf benachbarte Pixel überläuft, was zu einem Verschmieren heller Bereiche im Bild führt. CCD-Sensoren sind aufgrund ihres Auslesemechanismus anfälliger für Blooming als CMOS-Sensoren.

Was ist der Unterschied zwischen einem Global Shutter und einem Rolling Shutter?

Ein Global Shutter belichtet alle Pixel gleichzeitig, was ideal für die Aufnahme von sich schnell bewegenden Objekten ohne Verzerrungen ist. Ein Rolling Shutter belichtet die Pixel zeilenweise nacheinander, was bei schnellen Bewegungen zu Verzerrungen (z.B. Verbiegungen) führen kann. Viele moderne CMOS-Sensoren bieten mittlerweile Global Shutter.

Wie beeinflusst die Pixelgröße die Bildqualität?

Größere Pixel können in der Regel mehr Licht sammeln und haben eine höhere Ladungskapazität, was zu einem besseren Signal-Rausch-Verhältnis und einem höheren Dynamikbereich führt. Kleinere Pixel ermöglichen bei gleicher Sensorgröße eine höhere Auflösung, können aber anfälliger für Rauschen und Blooming sein und erfordern oft lichtstärkere Objektive oder längere Belichtungszeiten.

Was ist die Quanteneffizienz eines Sensors?

Die Quanteneffizienz gibt an, wie effizient ein Pixel ein einfallendes Photon in ein nutzbares Elektron (Ladung) umwandeln kann. Eine höhere Quanteneffizienz bedeutet, dass der Sensor empfindlicher ist und auch bei wenig Licht gute Bilder aufnehmen kann.

Warum gibt es Farb- und Monochrom-Sensoren?

Der Basissensor selbst registriert nur Lichtintensität, keine Farbe. Farbsensoren verwenden Filter (oft ein Bayer-Muster bei Single-Chip-Sensoren) oder Prismen (bei Drei-Chip-Sensoren), um Farbinformationen zu erhalten. Monochrom-Sensoren haben keine Farbfilter und sind daher lichtempfindlicher und bieten eine höhere native Auflösung (ohne Interpolation) für reine Helligkeitsinformationen, was in vielen industriellen oder wissenschaftlichen Anwendungen vorteilhaft ist.

Fazit

Der Bildsensor ist zweifellos eine der kritischsten Komponenten einer Kamera und beeinflusst maßgeblich die Qualität und die Eigenschaften des resultierenden Bildes. Das Verständnis der Unterschiede zwischen den vorherrschenden Technologien, CCD und CMOS, sowie ihrer spezifischen Merkmale wie Pixelgröße, Sensorgröße, Verschlussmechanismus und spektrale Eigenschaften ist entscheidend für die Auswahl der richtigen Kamera für eine bestimmte Anwendung. Während CCD-Sensoren in bestimmten Nischen, die höchste Lichtempfindlichkeit und Gleichmäßigkeit erfordern (wie einige wissenschaftliche oder astronomische Anwendungen), weiterhin relevant sind, hat die CMOS-Technologie durch ständige Weiterentwicklung in den letzten Jahren enorme Fortschritte gemacht. CMOS-Sensoren bieten heute oft eine überzeugende Kombination aus Geschwindigkeit, Effizienz, Flexibilität und Bildqualität zu geringeren Kosten, was sie zur ersten Wahl für eine breite Palette von Anwendungen macht, von Konsumentengeräten bis hin zu anspruchsvollen industriellen Systemen. Die zukünftige Entwicklung wird wahrscheinlich weitere Verbesserungen bei CMOS-Sensoren bringen, die ihre Dominanz im Markt weiter festigen werden, auch wenn spezielle Anforderungen weiterhin den Einsatz anderer Technologien rechtfertigen können.

Hat dich der Artikel Kamerachips: CCD vs. CMOS erklärt interessiert? Schau auch in die Kategorie Ogólny rein – dort findest du mehr ähnliche Inhalte!