Die Null. Ein kleines Symbol, ein Kreis oder ein Punkt, das auf den ersten Blick vielleicht unscheinbar wirkt oder sogar als Synonym für 'Nichts' verstanden wird. Doch hinter dieser scheinbar leeren Hülle verbirgt sich eine Zahl von immenser Bedeutung, deren Entwicklung die Mathematik, die Wissenschaft und unseren Alltag grundlegend verändert hat. Ihre Geschichte ist lang und komplex, und ihre Definition hat über Jahrhunderte hinweg Mathematiker und Philosophen beschäftigt. Ist die Null wirklich 'Nichts'? Oder ist sie eine vollwertige Zahl mit eigenen, einzigartigen Eigenschaften?

Um diese Fragen zu beantworten, begeben wir uns auf eine Reise durch die Welt der Zahlen, ihre Geschichte und ihre Definitionen. Wir werden sehen, wie die Null ihren Platz in den verschiedenen Mengen der Zahlen gefunden hat und welche Rolle sie dort spielt.

Was genau ist die Null?

In der Mathematik bezeichnet die Null ein Konzept, das je nach Kontext unterschiedlich definiert sein kann, aber oft als dasselbe Objekt betrachtet wird, das verschiedene kompatible Eigenschaften vereint. Sie ist die kleinste nicht-negative ganze Zahl und spielt eine zentrale Rolle in Stellenwertsystemen. Als Kardinalzahl repräsentiert sie die Anzahl der Elemente in der leeren Menge. Im Gegensatz zum alltäglichen Sprachgebrauch, wo 'Null' oft 'keine' bedeutet, ist die Null in der Mathematik eine eigenständige Einheit, mit der man rechnen kann.

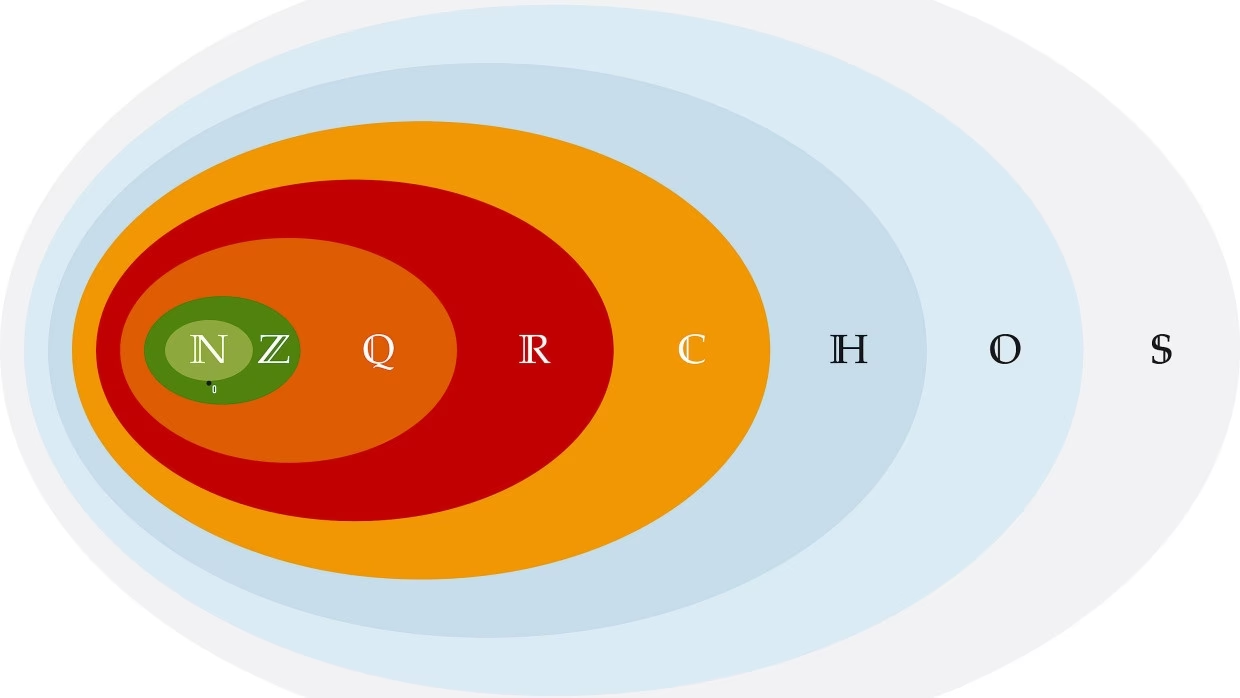

Die Null ist ein wichtiges Element in verschiedenen Zahlenmengen. Sie gehört zu den ganzen Zahlen (ℤ), den rationalen Zahlen (ℚ) und den reellen Zahlen (ℝ). Ob sie auch zu den natürlichen Zahlen (ℕ) gehört, ist eine Frage der Definition und Konvention, die wir später noch genauer beleuchten werden.

Null und die natürlichen Zahlen: Eine Definitionsfrage

Die Frage, ob die Null zu den natürlichen Zahlen gehört, ist historisch und mathematisch interessant. Die natürlichen Zahlen (ℕ) sind die Zahlen, die wir zum Zählen verwenden: 1, 2, 3, und so weiter. Sie entspringen dem Bedürfnis, Objekte zu abzählen und zu quantifizieren.

Traditionell und historisch zählte die Null nicht zu den natürlichen Zahlen. Die Null wurde in Europa erst ab dem 13. Jahrhundert gebräuchlich, während die natürlichen Zahlen schon viel länger existierten. Diese Definition, ℕ = {1, 2, 3, …}, ist in einigen mathematischen Gebieten wie der Zahlentheorie weiterhin verbreitet, insbesondere dort, wo die Multiplikation im Vordergrund steht.

In der modernen Mathematik, insbesondere in der Logik, der Mengenlehre und der Informatik, ist jedoch die Konvention gebräuchlicher, die Null zu den natürlichen Zahlen zu zählen: ℕ = {0, 1, 2, 3, …}. Diese Definition wird oft mit dem Symbol ℕ₀ gekennzeichnet, um Verwechslungen zu vermeiden, während die natürlichen Zahlen ohne Null manchmal mit ℕ⁺, ℕ∗, ℕ>0 oder ℕ∖{0} bezeichnet werden. In Deutschland verwendet die DIN-Norm 5473 beispielsweise ℕ für die nichtnegativen ganzen Zahlen (mit Null) und ℕ∗ für die positiven ganzen Zahlen (ohne Null), aber auch hier gibt es in der Schullandschaft Unterschiede.

Letztlich ist es eine Frage der Konvention, welche Definition man wählt. Beide sind mathematisch konsistent. Wichtig ist, dass man im Zweifelsfall klar angibt, welche Definition man verwendet.

Die faszinierende Geschichte der Null

Die Entwicklung der Null war kein einzelnes Ereignis, sondern ein Prozess, der sich über Jahrtausende in verschiedenen Kulturen vollzog. Lange Zeit kamen viele Zivilisationen ohne ein Symbol für die Null aus, oder sie nutzten Platzhalter, die noch nicht den vollen Status einer Zahl hatten.

Frühe Vorläufer: Babylon, Ägypten, Griechenland und Rom

Im alten Babylonien gab es im Sexagesimalsystem (Basis 60) bereits in der Perser- und Seleukidenzeit ein Fehlzeichen für leere Stellen. Davor wurde eine Lücke gelassen, was zu Mehrdeutigkeiten führen konnte. Erst ab etwa 200 v. Chr. wurde dieses Zeichen auch am Ende von Zahlen verwendet, vor allem in astronomischen Texten. Die Babylonier kannten zwar Differenzen, die null ergaben, hatten aber keinen Namen für null und betrachteten null nicht als Lösung algebraischer Aufgaben – sie kannten also noch keine Zahl Null.

Im alten Ägypten könnte es im 2. Jahrhundert v. Chr. am Horus-Tempel in Edfu eine Hieroglyphe für "nichts" gegeben haben, die vielleicht als Platzhalter oder für den Wert null bei der Flächenberechnung von Dreiecken verwendet wurde, indem eine Seite null gesetzt wurde. Dies ist jedoch eine unsichere Interpretation.

Die antiken Griechen kannten keine Zahl Null. Erst als sie die babylonische Astronomie übernahmen, nutzte Klaudios Ptolemaios im 2. Jahrhundert n. Chr. in Alexandria ein Symbol (o), vermutlich für griechisch οὐδέν („nichts“), als Platzhalter in seinen sexagesimalen Berechnungen.

Die Römer hatten ebenfalls kein Zeichen für die Null im Lateinischen und leisteten keine bedeutenden eigenen mathematischen Fortschritte in dieser Hinsicht.

Die Geburt der Null als Zahl: Indien und Südostasien

Der entscheidende Schritt zur Null als vollwertiger Zahl fand in Indien statt. Vermutlich unter Einfluss des babylonischen Systems und der Astronomie entstand dort zwischen 300 v. Chr. und 600 n. Chr. das dezimale Stellenwertsystem mit eigenen Ziffern für 1 bis 9 und einem Symbol für die Leere (śūnya). Ein Lückenzeichen wurde im dezimalen System unentbehrlich, da leere Stellen viel häufiger auftraten als im Sexagesimalsystem. Dies förderte die Akzeptanz der Null als Zahl.

Der älteste materielle Beleg für ein schriftliches Symbol der Null im indischen Raum findet sich möglicherweise im Bakhshali-Manuskript (3. oder 4. Jahrhundert n. Chr., obwohl die Datierung umstritten ist). Seit dem 7. Jahrhundert n. Chr. finden sich Inschriften mit einem Punkt oder Kreis als Symbol für die „Leere“. Der indische Mathematiker und Astronom Brahmagupta gab in seinem Werk von 628 n. Chr. bereits Rechenregeln auch für die Null an. Ein gesicherter Nachweis der Null als Zahl in Indien stammt von einer Steintafel aus Gwalior aus dem Jahr 786 n. Chr.

Auch in Südostasien, etwa in Kambodscha (Anfang 7. Jahrhundert) und Sumatra, gibt es frühe Belege für die Verwendung der Null in Inschriften, oft mit Begriffen, die „Luftraum“ oder „Leere“ bedeuten.

China und die Null

Das antike China kannte keine Zahl Null im Sinne eines eigenständigen Objekts zum Rechnen. Sie nutzten ein dezimales Stellenwertsystem mit Stäbchen (spätestens seit dem 1. Jahrhundert n. Chr.), das aber kein Fehlzeichen für leere Stellen hatte. Erst in der Übersetzung eines indischen astronomischen Textes (8. Jahrhundert n. Chr.) findet sich eine Erwähnung eines Punktes als Fehlzeichen. Interessanterweise kannten die Chinesen aber bereits im 1. Jahrhundert n. Chr. eine Art Matrizenrechnung, bei der leere Einträge Elementen mit dem Wert null entsprachen, und konnten damit rechnen – eine rechnerische Vorstufe der Zahl Null.

Die Null erreicht Europa

Nach dem Zerfall des Römischen Reiches wurde das Wissen in Byzanz und den islamisierten Gebieten bewahrt und weiterentwickelt. Arabische Mathematiker übernahmen die indischen Ziffern und das Dezimalsystem mit der Null. Das Werk „Über das Rechnen mit indischen Ziffern“ von al-Chwarizmi (um 825) trug maßgeblich zur Verbreitung bei.

Leonardo Fibonacci, der Sohn eines italienischen Handelsvertreters, lernte die arabisch-indischen Zahlen in Nordafrika kennen und stellte sie 1202 in seinem „Liber abaci“ in Italien vor. Er nannte die Null jedoch eher ein „Zeichen“ als eine vollwertige Zahl. Die Verwendung der Null im praktischen Rechnen setzte sich in Europa erst viel später, im 17. Jahrhundert, wirklich durch.

Die Null wurde zum Ausgangspunkt für viele Skalen (Temperatur, Meeresspiegel) und förderte das Verständnis von positiven und negativen Zahlen.

Die Null in der Neuen Welt: Olmeken und Maya

Auch in Mesoamerika gab es eine unabhängige Entwicklung der Null. Die Olmeken und später die Maya entwickelten ein Vigesimalsystem (Basis 20) mit einem Stellenwertsystem. Sie nutzten ein Symbol, das einer Muschel oder einem Schneckenhaus ähnelte, um Stellen mit dem Wert null zu kennzeichnen. Das älteste bekannte Datum in ihrem Kalender, das die Null verwendet, stammt aus dem Jahr 36 v. Chr.

Die Inka in Südamerika nutzten ebenfalls ein dezimales Stellenwertsystem in ihrer Knotenschrift (Quipus), bei dem eine Stelle ohne Knoten eine Null darstellte.

Die Null als Platzhalter und als Zahl

Ein zentrales Element in der Geschichte der Null ist die Unterscheidung zwischen ihrer Funktion als Platzhalter (Ziffer) und ihrem Wert als Zahl. Im Stellenwertsystem hat die Null als Ziffer die Funktion, das Fehlen einer Einheit an einer bestimmten Stelle anzuzeigen (z. B. in 102 zeigt die 0 an, dass keine Zehner vorhanden sind). Erst diese Platzhalterfunktion ermöglichte es, mit nur zehn Ziffern (0-9) jede beliebige Zahl eindeutig darzustellen.

Parallel dazu entwickelte sich die Vorstellung von der Null als Zahl, die einen Wert repräsentiert – nämlich die Anzahl der Elemente in einer leeren Menge oder den Punkt auf einer Skala. Dieser „Sprung“ von der Ziffer zur Zahl war entscheidend für die weitere Entwicklung der Mathematik, da er es ermöglichte, mit der Null wie mit jeder anderen Zahl zu rechnen.

Rechnen mit der Null: Besondere Regeln

Die Null hat einige einzigartige Eigenschaften, wenn es ums Rechnen geht, die sie von anderen Zahlen unterscheidet:

- Addition: Die Addition einer beliebigen Zahl x mit Null verändert die Zahl nicht: x + 0 = x. Die Null ist das neutrale Element der Addition.

- Multiplikation: Die Multiplikation einer beliebigen Zahl x mit Null ergibt immer Null: x * 0 = 0.

- Division: Die Division durch Null ist in der Mathematik nicht definiert. Man kann nicht durch Null teilen.

- Subtraktion: Die Subtraktion von Null von einer Zahl x verändert die Zahl nicht: x - 0 = x.

- Subtraktion mit Null als Ergebnis: Wenn man eine Zahl von sich selbst subtrahiert, ist das Ergebnis Null: x - x = 0.

Diese besonderen Regeln machen die Null zu einem faszinierenden Studienobjekt und können für Lernende, die an die Eigenschaften anderer Zahlen gewöhnt sind, zunächst eine Herausforderung darstellen.

Die Bedeutung der Null im Alltag

Auch außerhalb der reinen Mathematik begegnet uns die Null ständig und hat vielfältige Bedeutungen:

- Mengen: Wenn wir sagen, wir haben "keine Äpfel", meinen wir oft, dass die Anzahl der Äpfel Null ist.

- Skalen: Temperaturskalen (0°C, 0°F, 0 K), der Meeresspiegel (0 Meter über/unter Normalnull) oder Kontostände (0,00 €) nutzen die Null als Referenzpunkt.

- Codierung: In Telefonnummern, Postleitzahlen oder anderen Codes hat die Null keine besondere mathematische Bedeutung, sondern dient einfach als Ziffer.

- Redewendungen: "Bei Null anfangen" bedeutet einen Neuanfang, "eine Null sein" drückt Geringschätzung aus.

Oft verwenden wir im Alltag Umschreibungen wie "keine" oder "kostenlos", anstatt explizit die Zahl Null zu nennen, was die Vorstellung von der Null als eigenständiger Zahl manchmal erschwert.

Pädagogische Aspekte und Lernschwierigkeiten

Das Konzept der Null, insbesondere der Unterschied zwischen der Ziffer und der Zahl sowie ihre besonderen Rechenregeln, stellt Kinder im Mathematikunterricht oft vor Herausforderungen. Manche Kinder sehen die Null nur als Platzhalter oder als "Nichts", was zu Fehlern führen kann, wie der Annahme, dass Null bei jeder Rechenoperation zum Ergebnis Null führt oder das Ergebnis gar nicht beeinflusst.

Es gibt unterschiedliche Ansichten darüber, wann die Null im Mathematikunterricht eingeführt werden sollte. Manche plädieren dafür, sie erst mit dem Stellenwertsystem zu behandeln, da ihre Funktion dort am offensichtlichsten wird. Andere argumentieren, dass eine frühe Einführung als Zahl (z. B. durch Zählen von Mengen, die "Null" Elemente enthalten) wichtig ist, um Fehlvorstellungen entgegenzuwirken.

Wichtig ist, den Kindern die Dualität der Null – als Ziffer im Stellenwertsystem und als Zahl mit eigenem Wert und eigenen Rechenregeln – altersgerecht und anschaulich zu vermitteln.

Axiomatische Definitionen der natürlichen Zahlen

Neben der intuitiven Vorstellung als Zählzahlen gibt es auch formale, axiomatische Definitionen der natürlichen Zahlen, die implizit festlegen, ob die Null eingeschlossen ist oder nicht.

Die bekanntesten sind die Peano-Axiome, die von Giuseppe Peano 1889 aufgestellt wurden. Sie definieren die natürlichen Zahlen über ein Startobjekt (oft 0 oder 1) und eine Nachfolgerfunktion. Je nachdem, ob das Startobjekt als 0 oder 1 gewählt wird, ist die Null Teil der so definierten Menge oder nicht. Diese axiomatischen Systeme stellen sicher, dass die definierten Mengen der natürlichen Zahlen (ob mit oder ohne Null) bestimmte mathematische Eigenschaften erfüllen und im Wesentlichen gleich strukturiert sind (isomorph).

Eine andere Möglichkeit ist die mengentheoretische Konstruktion nach John von Neumann, bei der die natürlichen Zahlen als Mengen dargestellt werden. Hier beginnt die Konstruktion mit der leeren Menge als 0: 0 := {}, 1 := {0}, 2 := {0, 1}, und so weiter. Bei dieser Konstruktion ist die Null per Definition das erste Element und somit Teil der Menge der natürlichen Zahlen.

Die Null als Teilmenge der reellen Zahlen

Man kann die natürlichen Zahlen auch definieren, indem man vom Körper der reellen Zahlen (ℝ) ausgeht. Man definiert eine "induktive Menge" als eine Teilmenge von ℝ, die 0 enthält und für jedes Element x auch x+1 enthält. Die Menge der nichtnegativen ganzen Zahlen (ℕ₀) ist dann der Durchschnitt aller induktiven Teilmengen von ℝ.

Diese Definition identifiziert die natürlichen Zahlen mit einer Teilmenge der reellen Zahlen. Streng genommen sind die natürlichen Zahlen und die reellen Zahlen unterschiedliche mathematische Objekte, aber es gibt einen eindeutigen Weg, die natürlichen Zahlen "in die reellen Zahlen einzubetten", sodass sie sich dort wie natürliche Zahlen verhalten.

Zusammenfassung und Ausblick

Die Null ist weit mehr als nur die Abwesenheit von etwas. Sie ist eine Zahl mit einer reichen Geschichte, komplexen Definitionen und einzigartigen mathematischen Eigenschaften. Ihre Entwicklung vom einfachen Platzhalter zu einer vollwertigen Zahl war ein Meilenstein, der das moderne Stellenwertsystem und damit einen Großteil der heutigen Mathematik ermöglichte.

Ob sie nun zu den natürlichen Zahlen gezählt wird oder nicht, ihre Rolle als neutrales Element der Addition, als absorbierendes Element der Multiplikation und als Punkt, der positive von negativen Zahlen trennt, macht sie unverzichtbar. Die Null lehrt uns, dass "Nichts" in der Mathematik eine sehr bedeutsame Rolle spielen kann.

Häufig gestellte Fragen zur Null

Ist die Null eine natürliche Zahl?

Das hängt von der verwendeten Definition ab. Traditionell und in manchen Gebieten der Mathematik nicht (ℕ = {1, 2, 3, …}). In der modernen Mengenlehre, Logik und Informatik oft ja (ℕ = {0, 1, 2, 3, …}, oft auch als ℕ₀ bezeichnet).

Wo wurde die Null erfunden?

Ein Symbol für einen Platzhalter gab es in verschiedenen Kulturen (Babylon, Maya, China). Die Null als vollwertige Zahl mit Rechenregeln wurde jedoch in Indien erfunden, wahrscheinlich zwischen dem 5. und 7. Jahrhundert n. Chr.

Kann man durch Null teilen?

Nein, die Division durch Null ist in der Mathematik nicht definiert.

Ist die Null 'Nichts'?

Im alltäglichen Sprachgebrauch wird 'Null' oft als 'Nichts' verstanden (z. B. null Äpfel = keine Äpfel). Mathematisch ist die Null jedoch eine eigenständige Zahl, die einen Wert repräsentiert (z. B. die Anzahl der Elemente in einer leeren Menge) und mit der man rechnen kann.

Warum gibt es kein Jahr Null im Kalender?

Die Jahreszählung begann mit dem Jahr Eins. Das erste Jahr nach dem Jahr 1 v. Chr. ist das Jahr 1 n. Chr. Dies hat historische und kulturelle Gründe und steht im Einklang mit der Idee, dass das Zählen typischerweise mit Eins beginnt, nicht mit Null.

| Kultur / Epoche | Symbol / Konzept für Null oder Platzhalter | Status (Platzhalter/Zahl) |

|---|---|---|

| Alt-Babylonisch (~1800-1500 v. Chr.) | Lücke | Platzhalter (begrenzt) |

| Spät-Babylonisch (ab 200 v. Chr.) | Fehlzeichen (zwei kleine Keile) | Platzhalter |

| Ägypten (2. Jh. v. Chr.) | Hieroglyphe für "nichts" (?) | Möglicherweise Platzhalter/Wert Null (unsicher) |

| Hellenistische Welt (Ptolemaios, 2. Jh. n. Chr.) | Symbol 'o' | Platzhalter |

| Indien (ab 5.-7. Jh. n. Chr.) | Punkt oder Kreis (śūnya) | Zahl |

| Südostasien (ab 7. Jh. n. Chr.) | Begriff "Luftraum" (kha), Ziffer '0' | Zahl |

| China (ab 8. Jh. n. Chr.) | Punkt (erwähnt in Übersetzung) | Platzhalter (rechnerische Vorstufe als Wert) |

| Maya / Olmeken (ab 36 v. Chr.) | Muschel- oder Schneckenhaus-Symbol | Platzhalter |

| Inka (Quipus) | Stelle ohne Knoten | Platzhalter |

| Europa (Mittelalter / Neuzeit) | Ziffer '0' (ab 13. Jh. gebräuchlich) | Entwicklung von Platzhalter zu Zahl |

Hat dich der Artikel Die Null: Mehr als nur 'Nichts' interessiert? Schau auch in die Kategorie Ogólny rein – dort findest du mehr ähnliche Inhalte!