Selbstfahrende Autos, die uns sicher von A nach B bringen, sind keine ferne Zukunftsmusik mehr. Doch wie navigieren diese Fahrzeuge durch den komplexen Straßenverkehr? Sie verlassen sich auf hochentwickelte Sensorsysteme, die es ihnen ermöglichen, ihre Umgebung in Echtzeit wahrzunehmen und darauf zu reagieren. Ohne diese 'Sinne' könnten Computersysteme weder die Geschwindigkeit bestimmen, noch wissen, wann sie abbiegen oder bremsen müssen. Das Sensorsystem muss jede Bewegung in seiner Reichweite erkennen, um in Sekundenbruchteilen lebensrettende Entscheidungen zu treffen. Im Kern dieser Wahrnehmungstechnologie stehen vor allem zwei Hauptsysteme, oft ergänzt durch Radar: Kameras und LiDAR.

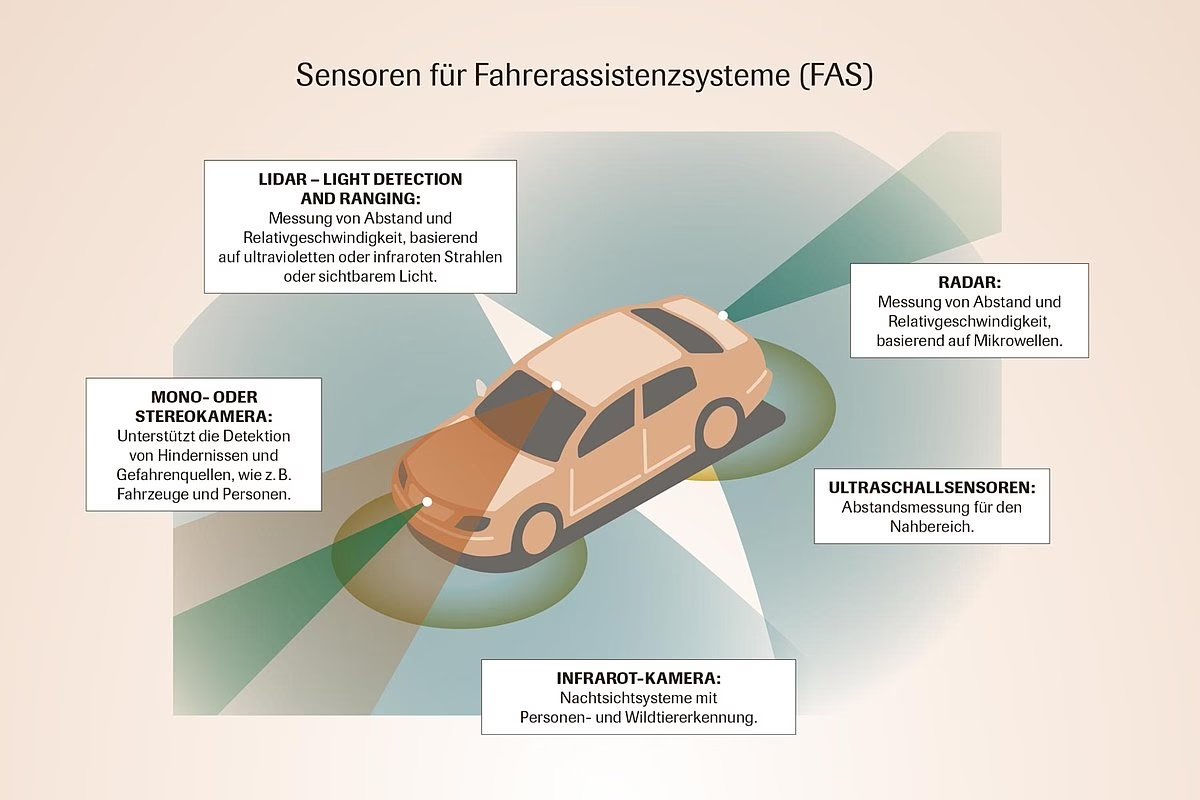

Heute nutzen selbstfahrende Autos hauptsächlich drei Mechanismen zur Umgebungserkennung. Kameras sind weit verbreitet, da sie die Umgebung visuell erfassen können, ähnlich wie das menschliche Auge. Radar wird oft zusammen mit Kameras eingesetzt, um große Objekte zu erkennen. LiDAR, eine neuere Technologie, verwendet Lichtimpulse zur Entfernungsmessung. Einige Unternehmen setzen auf eine Kombination aller drei Sensoren.

Wie autonome Autos ihre Umgebung wahrnehmen

Die Fähigkeit, die unmittelbare Umgebung präzise zu erfassen, ist die Grundlage für autonomes Fahren. Sensoren liefern die Daten, die der Bordcomputer benötigt, um zu 'sehen', was um das Fahrzeug herum passiert. Dies umfasst die Erkennung anderer Fahrzeuge, Fußgänger, Radfahrer, Hindernisse, Fahrbahnmarkierungen und Verkehrszeichen. Die Genauigkeit und Geschwindigkeit dieser Wahrnehmung sind entscheidend für die Sicherheit.

Die drei primären Sensortypen, die in autonomen Fahrzeugen zum Einsatz kommen, sind:

- Kameras: Erfassen visuelle Informationen, ähnlich dem menschlichen Sehen. Sie sind relativ kostengünstig und können Farben und Details erkennen.

- Radar: Verwendet Radiowellen zur Erkennung von Objekten und deren Geschwindigkeit. Funktioniert gut bei schlechtem Wetter, hat aber eine geringere Auflösung als Kameras oder LiDAR.

- LiDAR: Nutzt Laserpulse zur Erstellung einer 3D-Karte der Umgebung. Bietet sehr genaue Entfernungsmessungen und ist unempfindlich gegenüber Lichtverhältnissen (Schatten, Helligkeit).

Historisch gesehen verließen sich viele Unternehmen stark auf LiDAR, da neuronale Netze bis vor kurzem nicht leistungsfähig genug waren, um mehrere Kameraeingaben gleichzeitig zu verarbeiten. Doch die Technologie entwickelt sich rasant, und die Debatte, welcher Sensor oder welche Kombination die beste Lösung darstellt, ist aktueller denn je.

Was ist LiDAR?

LiDAR steht für Light Detection and Ranging. Ähnlich wie Radar, das Radiowellen nutzt, verwendet LiDAR Laserpulse, um die Umgebung zu 'sehen'. Millionen von Laserpulsen pro Sekunde werden ausgesendet und prallen von Objekten ab. Das Auto misst dann die Zeit, die die Laserpulse benötigen, um zurückzukehren, und berechnet daraus die Entfernung zu den Objekten. Dieses System muss extrem fein abgestimmt und genau sein, um sofortige Entscheidungen mit schnelleren Reaktionszeiten als Menschen treffen zu können.

LiDAR-Einheiten waren früher oft als auffällige, sich drehende Sensoren auf dem Dach von Testfahrzeugen zu sehen. Unternehmen wie Waymo, eine Tochtergesellschaft von Googles Mutterkonzern Alphabet, haben proprietäre LiDAR-Systeme entwickelt. Diese Technologie war sogar Gegenstand eines Patentstreits zwischen Google und Uber im Rennen um die Entwicklung der sichersten autonomen Fahrzeuge.

Velodyne ist ein großer Anbieter traditioneller, kostspieliger LiDAR-Einheiten. Doch zahlreiche Startups arbeiten daran, kleinere und günstigere LiDAR-Systeme zu entwickeln. Luminar verwendet beispielsweise eine spezielle Metalllegierung und Laser mit einer Wellenlänge von 1550 Nanometern (im Vergleich zu traditionellen 905 nm), was eine größere Reichweite und bessere Erkennung ermöglicht. Ouster entwickelt Festkörperlaser auf Chips. Mit zunehmender Verbreitung von LiDAR-Einheiten sinken die Preise langsam.

Vorteile von LiDAR

Einer der Hauptvorteile von LiDAR ist seine hohe Genauigkeit und Präzision. Das ist der Grund, warum Unternehmen wie Waymo ihre LiDAR-Systeme so schützen. Waymos LiDAR soll so fortschrittlich sein, dass es erkennen kann, in welche Richtung Fußgänger schauen, und deren Bewegungen vorhersagen kann. Chrysler Pacificas, ausgestattet mit Waymos LiDAR, können angeblich sogar Handzeichen von Radfahrern erkennen, um deren Richtungswechsel vorherzusagen.

Ein weiterer Vorteil ist, dass LiDAR autonome Autos mit einem dreidimensionalen Bild der Umgebung versorgt. LiDAR ist im Vergleich zu Kameras äußerst genau, da die Laser nicht durch Schatten, helles Sonnenlicht oder entgegenkommende Scheinwerfer anderer Autos getäuscht werden.

Schließlich spart LiDAR Rechenleistung. Es kann sofort die Entfernung und Richtung zu einem Objekt bestimmen. Ein kamerabasiertes System muss hingegen zunächst Bilder erfassen und diese dann analysieren, um Entfernung und Geschwindigkeit von Objekten zu ermitteln, was deutlich mehr Rechenleistung erfordert.

Bislang setzen nur wenige Autohersteller LiDAR in Serienfahrzeugen für Endkunden ein. Audi hat in einigen Modellen wie dem A8 und A6 ein nach vorne gerichtetes LiDAR verbaut. Volvo hat angekündigt, LiDAR im Volvo EX90 zu integrieren. Ansonsten ist LiDAR derzeit noch hauptsächlich im Bereich von Ride-Hailing-Diensten und autonomen Flotten zu finden.

Nachteile von LiDAR

Historisch gesehen war der Preis einer der größten Nachteile von LiDAR. Googles ursprüngliches System kostete angeblich über 75.000 US-Dollar. Heute haben Startups die Kosten für LiDAR-Einheiten gesenkt, im Fall von Luminar auf unter 1.000 US-Dollar. Velodyne stellte auf der CES 2020 sogar eine abgespeckte Version namens Velabit für 100 US-Dollar vor. Es bleibt jedoch abzuwarten, wie viele dieser Einheiten pro Fahrzeug benötigt werden. Die Kosten für LiDAR können daher immer noch einen erheblichen Aufpreis für Endkundenfahrzeuge darstellen und werden wahrscheinlich noch eine Weile hauptsächlich in autonomen Flotten Anwendung finden.

Interferenz und Störung sind weitere potenzielle Probleme, wenn diese Systeme breiter eingesetzt werden. Wenn eine große Anzahl von Fahrzeugen gleichzeitig Laserpulse aussendet, könnte dies zu Interferenzen führen und die Fahrzeuge potenziell 'blenden'. Hersteller müssen Methoden entwickeln, um diese Störungen zu verhindern.

Es ist auch noch nicht klar, welche Auswirkungen so viel konstante Laseraktivität auf andere mechanische und biologische Systeme in der Umwelt haben könnte. Velodyne behauptet beispielsweise, dass LiDAR, das bei 1550 nm arbeitet (wie es Konkurrent Luminar tut), unter bestimmten Umständen die menschliche Hornhaut schädigen könnte. Auf der CES 2019 berichtete jemand, dass sein Kamerasensor durch LiDAR beschädigt wurde. Es gibt noch viele offene Fragen zur Umweltsicherheit von LiDAR im großen Maßstab.

LiDAR hat auch die Einschränkung, dass viele Systeme noch nicht gut durch Nebel, Schnee und Regen sehen können. Ford, ein weiterer führender Akteur in der Entwicklung autonomer Fahrzeuge, hat einen Algorithmus entwickelt, der seinem LiDAR-System hilft, zwischen einzelnen Regentropfen und Schneeflocken zu unterscheiden. Andernfalls würden autonome Fahrzeuge eine Masse fallender Schneeflocken als Wand mitten auf der Straße interpretieren. Ford hat sein Konzept bei Tests in Michigan bewiesen, aber das Programm hat noch viel zu lernen.

Zusätzlich liefert LiDAR keine Informationen, die Kameras typischerweise sehen können – wie die Wörter auf einem Schild oder die Farbe einer Ampel. Kameras sind für diese Art von Informationen besser geeignet.

Schließlich können LiDAR-Systeme, wenn sie ins Fahrzeug integriert sind, sichtbarer sein. Kamerasysteme hingegen, wie sie beispielsweise bei aktuellen Tesla-Fahrzeugen implementiert sind, sind fast unsichtbar. LiDAR-Systeme werden jedoch jedes Jahr kleiner.

Warum Kameras?

Kameras im autonomen Fahren funktionieren ähnlich wie unser menschliches Sehen und nutzen Technologien, die in den meisten Digitalkameras zu finden sind.

Wie Tesla-CEO Elon Musk es ausdrückt: „Das gesamte Straßensystem ist dafür ausgelegt, mit passiver Optik, also Kameras, navigiert zu werden. Wenn man also Kameras oder Vision löst, ist Autonomie gelöst. Wenn man Vision nicht löst, ist es nicht gelöst.“ Anstatt ein völlig neues System des Sehens zu erfinden, möchte Musk, dass sein Unternehmen „übermenschliche Augen“ schafft, die eine viel bessere Sehschärfe als biologische Augen haben.

Um das Problem zu lösen, stellt Tesla sicher, dass genügend Kameras um das Auto herum platziert sind (insgesamt 8), die in alle Richtungen sehen können. Tesla-Fahrzeuge sollen lernen, mit ihrer integrierten Kameratechnologie besser zu sehen und schneller zu reagieren als menschliche Fahrer.

Musks starkes Vertrauen in die Kameratechnologie mag für viele weit hergeholt klingen, aber wie er auf Teslas erstem Autonomy Day für Investoren demonstrierte, glaubt er, dass die Kameraanordnung für selbstfahrendes Fahren ausreicht. Er erklärte, dass Tesla seine Sensor-Suite viele Male neu bewertet hat und keinen Grund sah, sie anzupassen. Im Jahr 2021 entfernte Tesla sogar das Radar, um sich noch stärker auf Kameras zu konzentrieren. Dies scheint sich in der neuesten Version des Autopilot auszuzahlen, die erhebliche Fortschritte bei autonomen Funktionen gezeigt hat, aber noch weit davon entfernt ist, für Endkunden bereit zu sein. Das könnte ein Grund sein, warum Tesla mit Hardware 4, die 2023 eingeführt wird, das Radar wieder einführt.

Auch Mobileye, das ursprünglich die Autopilot-Technologie für Tesla in AP1-Fahrzeugen lieferte, treibt ein kamerabasiertes System voran. Es verfügt über 12 Kameras: drei vorne, zwei Eckkameras nach vorne gerichtet, zwei Eckkameras nach hinten gerichtet, eine Rückfahrkamera und vier zusätzliche Kameras für Parkansichten.

Insgesamt scheint es, dass Kameras in der Lage sind, die Umgebungswahrnehmung zu übernehmen, zumindest so gut wie Menschen.

Warum Kameras so beliebt sind

Erstens sind Kameras viel kostengünstiger als LiDAR-Systeme, was die Kosten für selbstfahrende Autos senkt, insbesondere für Endkunden. Sie sind auch einfacher zu integrieren (moderne Teslas haben acht Kameras um das Auto herum), da Videokameras bereits auf dem Markt sind. Tesla kann einfach eine handelsübliche Kamera kaufen und verbessern, anstatt eine völlig neue Technologie zu entwickeln.

Ein weiterer Vorteil ist, dass Kameras nicht blind für Wetterbedingungen wie Nebel, Regen und Schnee sind. Die LiDAR-Lösung von Ford für schlechte Bedingungen erfordert Softwareverbesserungen, aber Teslas Kameras haben nicht die gleichen Probleme wie die physischen Einschränkungen von LiDAR. Was ein normaler Mensch navigieren kann, kann auch ein kamerabasiertes System.

Kameras können die Welt auch auf die gleiche Weise wie Menschen sehen und können theoretisch Straßenschilder lesen, Farben interpretieren usw., im Gegensatz zu LiDAR.

Schließlich lassen sich Kameras einfach in das Design des Autos integrieren und in den Fahrzeugstrukturen verstecken, was sie für Endkundenfahrzeuge attraktiver macht.

Kameras haben auch in anderen Bereichen beeindruckende Leistungen gezeigt, beispielsweise bei Drohnen. Skydio stellt beispielsweise die Skydio 2 Drone her, die Objekten automatisch folgen und Hindernisse umfahren kann, indem sie nur 6 Kameras um die Drohne herum und eine NVIDIA Tegra TX2 für die Rechen-KI nutzt (ähnlich wie Teslas Full Self-Driving Computer, aber weniger leistungsfähig).

Das System in der Skydio 2 Drone ist eine beeindruckende Demonstration dessen, was im 3D-Raum nur mit Kameras plus KI, visueller Odometrie und SLAM (Simultaneous Localization and Mapping) erreicht werden kann. Die von diesem Kamerasystem gesammelten Daten ähneln stark denen von LiDAR.

Einschränkungen von Kameras

Kameras unterliegen denselben Problemen, denen auch Menschen gegenüberstehen, wenn sich die Lichtverhältnisse ändern und das Motiv dadurch verdeckt wird. Man denke an Situationen, in denen starke Schatten oder helle Lichter, von der Sonne oder entgegenkommenden Autos, zu Verwirrung führen können.

Ein Beispiel für eine Situation mit wenig Licht wurde von Luminar auf der CES 2022 in Las Vegas demonstriert. Ein kleines Kind, das von einem anderen Auto verdeckt wird, tritt vor ein Auto, und das Auto muss den Fußgänger erkennen und schnell reagieren. Luminar testete dieses Szenario mit einem Referenzfahrzeug und verglich es dann mit anderen Fahrzeugen (wie einem Tesla Model Y) unter schwierigen Bedingungen mit wenig Licht. Das Tesla-Fahrzeug konnte in diesem Beispiel die Dummy-Fußgängerpuppe nicht erkennen und vermeiden.

Zusätzlich sind Kameras relativ „dumme“ Sensoren, da sie dem System nur rohe Bilddaten liefern, im Gegensatz zu LiDAR, das die genaue Entfernung und Position eines Objekts liefert. Das bedeutet, dass Kamerasysteme auf leistungsstarke maschinelle Lerncomputer (neuronale Netze oder Deep Learning) angewiesen sind, die diese Bilder verarbeiten können, um genau zu bestimmen, was sich wo befindet, ähnlich wie unser menschliches Gehirn die Stereosicht unserer Augen verarbeitet, um Entfernung und Position zu bestimmen.

Bis vor kurzem waren die neuronalen Netze / maschinellen Lernsysteme einfach nicht leistungsfähig genug, um große Datenmengen von Kameras zu verarbeiten, um alles rechtzeitig für Fahrentscheidungen zu verarbeiten. Die Entwicklung neuronaler Netze ist jedoch viel anspruchsvoller geworden, so dass sie reale Eingaben potenziell besser verarbeiten können als LiDAR.

Tesla hat eine zukunftsweisende Lösung gefunden, um das Problem der Rechenleistung in ihren Autos zu lösen. Sie haben das Computersystem so integriert, dass es leicht gegen zukünftige Hardware ausgetauscht werden kann. Anfang 2019 rüstete Tesla von der bisherigen NVIDIA-Lösung auf eigenes Silizium um, den Full Self Driving Computer (oder Hardware 3), was die Verarbeitungsfähigkeiten ihrer Autos erheblich steigerte.

Sensorfusion: Das Beste aus beiden Welten?

Eine praktikable Lösung in der LiDAR-gegen-Kamera-Debatte für selbstfahrende Autos ist die Kombination der Technologien, bekannt als Sensorfusion.

Mobileye, das sich hauptsächlich auf visuelle Wahrnehmung konzentriert, nutzt auch Eingaben von LiDAR und Radar, um die Umgebung zu erfassen, und kann dies als sekundäres, redundantes System zum visuellen Wahrnehmungssystem verwenden. TuSimple, ein Unternehmen für autonome Lastwagen, verfolgt den Ansatz, Radar, Sensoren und Kameras zu kombinieren.

Bei der Sensorfusion ist zu beachten, dass jeder Datenpunkt eine weitere Eingabe ist, die die Computersysteme lernen und interpretieren müssen. Ob LiDAR, Kameras oder eine Fusion aus beiden – all diese High-Tech-Systeme sind nur so gut wie die Computerprogramme, die geschrieben wurden, um die Daten mit Millisekunden-Präzision zu interpretieren. Menschen müssen exakte Computercodes und Algorithmen schreiben und testen, damit jede physische Hardware ordnungsgemäß funktioniert.

Angesichts der vielen Dinge, auf die ein Mensch im Straßenverkehr achten muss, ist es keine leichte Aufgabe, Millionen von Datenbits ordnungsgemäß in das Computersystem eines Autos fließen zu lassen. Bei der Fusion mehrerer Sensoren muss das System neu lernen, mit allen harmonisch zusammenzuarbeiten. Einige Experten argumentieren, dass Sensorfusion komplexer sein kann als die alleinige Konzentration auf visuelle Daten.

Die Zukunft der Sensorik

Angesichts der jüngsten Fortschritte in der kamerabasierten Vision-Technologie ist es wahrscheinlich, dass wir eine Verbreitung von Kamerasystemen in Endkundenfahrzeugen sehen werden, insbesondere angesichts der niedrigeren Kosten und der jüngsten Fortschritte bei der KI.

Allerdings wird LiDAR wahrscheinlich ein fester Bestandteil in Ride-Sharing-Fahrzeugen bleiben, da diese Unternehmen über Jahre hinweg stark in diese Technologie investiert haben und sie zusätzliche Eingaben für das Wahrnehmungssystem liefert, was die Rechenkomplexität reduziert. Da Ride-Sharing-Fahrzeuge die anfänglichen Hardwarekosten für LiDAR durch den Wegfall des menschlichen Fahrers wieder hereinholen können, sind die Kosten für LiDAR weniger ein Problem als bei Endkundenfahrzeugen. Wenn LiDAR durch starke Investitionen von Startups günstiger wird, wird es wahrscheinlich in mehr Endkundenfahrzeugen neben Kameras und Radar erscheinen, falls die LiDAR-Interferenzprobleme gelöst werden können, aber wahrscheinlich zunächst in einer begrenzten Anzahl von Autos, wie dem Volvo EX90, Audi und anderen.

Eines ist sicher: Die von selbstfahrenden Fahrzeugen verwendeten Sensoren werden sich weiterentwickeln und über die menschliche Wahrnehmung (d.h. das Sehen) hinausgehen, wie es bereits bei der Einbeziehung von Radar der Fall ist. Selbst Tesla führt mit Hardware 4 eine präzisere Radareinheit wieder ein. Während Kameras theoretisch und praktisch selbstfahrende Autos antreiben können, werden auch weiterhin andere Sensoren (ob LiDAR im großen Maßstab eingesetzt wird, bleibt abzuwarten) dem Wahrnehmungsstapel hinzugefügt, um die Umgebungsdetektion in Zukunft zu verbessern.

Häufig gestellte Fragen

Haben selbstfahrende Autos Kameras?

Ja, die meisten selbstfahrenden Autos sind mit Kameras ausgestattet. Kameras sind ein grundlegender Sensor, da sie visuelle Informationen ähnlich wie das menschliche Auge erfassen. Sie sind relativ kostengünstig und können Details, Farben und Schrift auf Schildern erkennen. Unternehmen wie Tesla setzen sogar primär auf Kameras für ihre autonomen Fahrfunktionen.

Ist LiDAR für selbstfahrende Autos besser als Kameras?

Es gibt keine eindeutige Antwort darauf, ob LiDAR besser ist als Kameras. Beide Technologien haben spezifische Vor- und Nachteile. LiDAR ist sehr präzise bei der Entfernungsmessung, liefert ein 3D-Bild und ist unempfindlich gegenüber Lichtverhältnissen. Kameras sind kostengünstiger, erkennen Farben und Details (wie Schilder) und sind weniger anfällig für Probleme bei Nebel oder Regen als einige LiDAR-Systeme. Unternehmen verfolgen unterschiedliche Ansätze: Waymo nutzt eine Kombination aus Sensoren, einschließlich hochentwickeltem LiDAR, während Tesla stark auf Kameras und neuronale Netze setzt. Viele Experten sehen die Zukunft in der Sensorfusion, bei der die Stärken verschiedener Sensoren kombiniert werden, um eine robustere Wahrnehmung zu erreichen.

Warum ist die Umgebungswahrnehmung für autonome Autos so wichtig?

Die Umgebungswahrnehmung ist absolut entscheidend für autonome Autos, da sie die einzige Möglichkeit ist, die Welt um das Fahrzeug herum zu 'sehen' und zu verstehen. Sensoren liefern die Daten über die Position, Bewegung und Art von Objekten in der Nähe. Ohne diese Informationen könnte der Bordcomputer keine Fahrentscheidungen treffen, wie z.B. Beschleunigen, Bremsen, Lenken oder Ausweichen. Die Genauigkeit und Zuverlässigkeit der Sensorik sind direkt proportional zur Sicherheit des autonomen Fahrzeugs.

Welche Unternehmen setzen auf welche Sensortechnologie?

Viele Unternehmen im Bereich des autonomen Fahrens, wie Waymo und die meisten Entwickler von Robotaxis und autonomen Flotten, setzen auf eine Kombination aus LiDAR, Kameras und Radar (Sensorfusion), wobei LiDAR oft eine zentrale Rolle spielt. Tesla ist ein bemerkenswertes Beispiel für ein Unternehmen, das stark auf Kameras und leistungsstarke KI setzt, obwohl sie in neueren Hardwareversionen auch Radar wieder einbeziehen. Automobilhersteller wie Audi und Volvo integrieren zunehmend auch LiDAR, oft in Kombination mit Kameras und Radar, in ihre fortschrittlicheren Fahrerassistenzsysteme und zukünftigen autonomen Modelle.

Was ist Sensorfusion?

Sensorfusion ist der Prozess der Kombination von Daten aus verschiedenen Sensortypen (wie Kameras, LiDAR und Radar), um ein umfassenderes und zuverlässigeres Bild der Umgebung zu erstellen. Durch die Nutzung der Stärken jedes Sensors können die Schwächen der anderen ausgeglichen werden. Beispielsweise können Kameras Details und Farben erkennen, LiDAR liefert präzise 3D-Entfernungsdaten, und Radar funktioniert gut bei schlechtem Wetter und misst Geschwindigkeiten. Die Herausforderung liegt darin, die Daten aus den verschiedenen Quellen synchron und konsistent zu verarbeiten und zu interpretieren.

Vergleich: Kameras vs. LiDAR

| Merkmal | Kameras | LiDAR |

|---|---|---|

| Kosten | Relativ gering | Historisch hoch, sinkt aber |

| Erfassung | Visuelle Bilder (2D) | Punktwolken (3D) |

| Entfernungsmessung | Indirekt (erfordert komplexe Verarbeitung) | Direkt und präzise |

| Lichtverhältnisse | Empfindlich gegenüber Schatten, starkem Licht | Unempfindlich gegenüber Lichtverhältnissen |

| Wetter (Nebel, Regen, Schnee) | Weniger anfällig als LiDAR (kann sehen, was Mensch sieht) | Kann eingeschränkt sein (erfordert oft Software-Workarounds) |

| Details (Schilder, Farben) | Gut | Nicht direkt erfassbar |

| Rechenleistung | Erfordert hohe Rechenleistung (für Objekterkennung, Entfernung) | Weniger Rechenleistung für Grunddaten (Entfernung, Position) |

| Integration/Sichtbarkeit | Einfach zu verstecken | Kann auffälliger sein (wird aber kleiner) |

Fazit

Die Frage, ob Kameras oder LiDAR die überlegene Technologie für selbstfahrende Autos sind, ist komplex und wird von verschiedenen Unternehmen unterschiedlich beantwortet. Kameras sind kostengünstig und erfassen visuelle Informationen, die für das Navigieren im menschlich gestalteten Verkehrssystem essenziell sind. LiDAR bietet unübertroffene Präzision bei der Entfernungsmessung und liefert robuste 3D-Daten, unabhängig von den Lichtverhältnissen. Die Einschränkungen beider Systeme – Kameras bei schwierigem Licht, LiDAR bei Wetter und Kosten – deuten darauf hin, dass eine Kombination, die Sensorfusion, oft den vielversprechendsten Weg darstellt, um die notwendige Redundanz und Zuverlässigkeit für sicheres autonomes Fahren zu erreichen. Während die Technologie weiter voranschreitet, ist klar, dass die Sensorik das Herzstück der autonomen Mobilität bleibt und sich kontinuierlich weiterentwickeln wird, um Fahrzeuge noch intelligenter und sicherer zu machen.

Hat dich der Artikel Kameras vs. LiDAR: Augen autonomer Autos interessiert? Schau auch in die Kategorie Ogólny rein – dort findest du mehr ähnliche Inhalte!